开云提款靠谱官方入口

开云提款靠谱官方入口

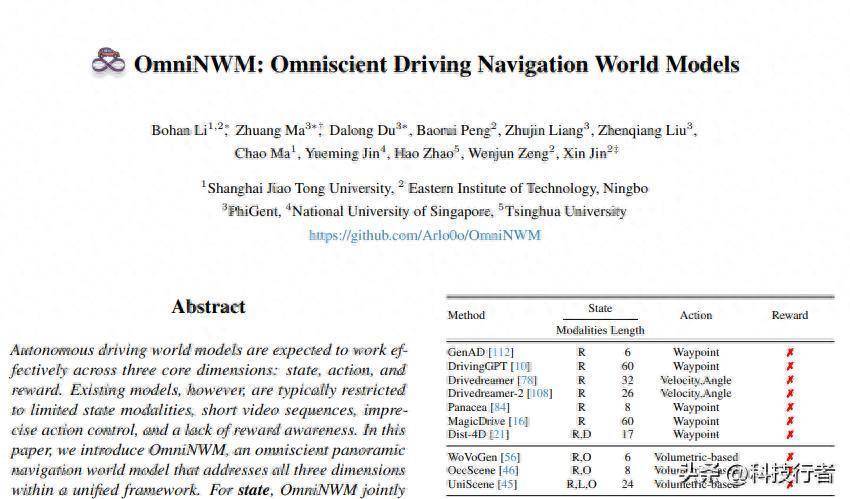

这项由上海交通大学的李博涵团队和东部理工学院宁波分校、PhiGent公司、新加坡国立大学、清华大学等多家机构合作完成的照料,发表于2024年10月的arXiv预印本论文做事器(论文编号:arXiv:2510.18313v2),有兴味深入了解的读者不错通过该编号查询完整论文。

想象一下,如若有一个AI探员专门庄重自动驾驶汽车的"眼睛",它不仅要能看懂路上发生的一切,还要能预测下一秒会发生什么,以致要判断哪种驾驶行径更安全。听起来像科幻电影,但上海交通大学的照料团队果然作念到了。他们诱导出了一个名为OmniNWM的系统,就像给自动驾驶汽车配备了一个无所不知的超等大脑。

传统的自动驾驶系统就像只会看单一踪迹的外行探员,只可分析无为的RGB图像,况且只可看很短时候内的情况。但OmniNWM就像一个教训丰富的老探员,它能同期"看到"彩色画面、会通每个物体的含义、测量物体的距离,以致能构建出悉数这个词三维天下的完整模子。更神奇的是,它还能像预言家一样,准确预测将来很永劫候内会发生什么。

这个系统的中枢改进在于它处罚了自动驾驶天下模子的三个根底问题。第一个问题就像探员需要汇集饱和各样的笔据一样,昔日的系统只可看到有限的信息,而OmniNWM大致同期处理彩色图像、语义信息、深度数据和三维占用情况。第二个问题雷同于探员需要精准限定访问标的,OmniNWM创造了一种全新的"导航舆图"方法,大致精准限定捏造录像头的挪动。第三个问题就像探员需要判断哪个嫌疑东谈主更危境一样,OmniNWM大致基于生成的三维天下径直评判驾驶行径的安全性。

照料团队的这项使命特殊令东谈主振作,因为它是第一个信得过兑现了"全景式"自动驾驶天下会通的系统。昔日的系统就像只可看到拼图的几块碎屑,而OmniNWM大致看到完整的画面。它不仅能生成长达321帧的一语气视频序列,比传统方法长出好多,还能在完全莫得针对性查考的情况下,在不同数据集和录像头建立下使命,展现出了惊东谈主的适当能力。

一、全景探员的超等办法:多模态信息的圆善会通

传统的自动驾驶系统就像一个只可用单眼看天下的探员,诚然能看到基本的画面,但对天下的会通很有限。OmniNWM的第一个突破便是给这个AI探员装上了"复合眼",让它能同期看到彩色天下、会通物体含义、测量距离,还能构建完整的三维模子。

这种多醉心觉能力的兑现旨趣其实很奥妙。照料团队瞎想了一个雷同于"调和翻译器"的系统,它能把不同类型的视觉信息转念成兼并种"讲话"。具体来说,系统当先使用一个预查考的三维视频编码器,把输入的视频帧压缩成紧凑的时空特征,压缩比例达到4×8×8,就像把一张高清相片压缩成小文献但不丢失要道信息。

然后,系统使用一个名为全景扩散变换器(PDiT)的中枢组件来处理这些压缩后的特征。这个变换器遴荐了跨视角留心力机制,就像一个能同期温雅多个标的的超等眼球,大致协转念理来自不同录像头角度的信息。最终,解码器将处理后的特征归附成像素级对王人的RGB图像、语义图和深度图。

为了确保不同模态之间的一致性,照料团队遴荐了一个很理智的计谋。在查考过程中,语义图被着色后再进行编码,解码后通过最周边匹配转念回破碎标签。这就像给每种类型的信息都贴上了调和的标签,确保它们大致圆善对应。

这种合资生成有谈论最大的上风是确保了跨模态的强像素级对王人,这关于生成高质地的三维占用图至关紧迫。就像拼图游戏中每块拼图都必须圆善契合,不同类型的视觉信息也必须在每个像素点上都保抓一致,这么才能构建出准确的三维天下模子。

二、三维天下的数字重建:从平面图像到立体空间

如若说前边讲的是给AI探员装上了复合眼,那么三维占用生成便是教化它怎样会通空间关系,构建完整的案发现场模子。这个过程就像法医重建不法现场一样,需要从有限的笔据中归附出完整的三维空间。

OmniNWM的占用模块大致从全景RGB图像、深度图和语义图中生成三维体素体积。悉数这个词过程遴荐了一个基于预查考EfficientNet-B7的UNet架构来索取图像特征。这个集聚就像一个教训丰富的建筑师,大致从二维图纸中会通三维结构。

具体的使命进程是这么的:当先,系统索取RGB图像特征,然后分别处理深度图和语义图,通过下采样和卷积层产生深度特征和语义特征。接下来,SE3D模块在图像特征与深度/语义特征之间奉行自适当团聚。最终的三维语义体素体积通过一个奥妙的外积运算得到,公式是Vb = Adapd(Fi, Fd) ? Adaps(Fi, Fs),其中Adapd和Adaps是深度和语义凹凸文的自适当团聚集聚。

这种瞎想比拟于径直合成完整占用网格的体积化方法有很大上风。传统的体积化方法就像要一语气建造整栋大楼,谈论资本极高且难以膨大到长序列。而OmniNWM的方法更像是先准备好各式建筑材料(轻量级像素对王人特征),然后高效地拼装成最终的建筑(三维占用图)。这种方法不仅大致膨大到长序列处理,更紧迫的是为集成基于占用的密集驾驶奖励提供了可能。

生成的三维占用图不单是是一个静态的空间模子,它还大致支抓基于法子的密集奖励谈论。系统运用NuScenes-Occupancy数据集的类别分类法,大致进行逐航线点的奖励谈论。这就像给每个空间位置都贴上了详备的标签,告诉AI这里是谈路、那儿是按捺物、辽远是建筑等等。

三、精准导航的数字罗盘:范例化全景射线图限定

如若把OmniNWM比作一个捏造的电影影相师,那么范例化全景射线图便是它的精密操控系统,大致兑现极其准确的镜头限定。传统的驾驶天下模子在动作限定方面存在两个主要问题:一是使用疏淡的矢量化示意(比如旅途点)难以准确描画多视角场景,二是数据蚁集轨迹各样性有散伙约了模子的泛化能力。

照料团队提倡的处罚有谈论是将轨迹转念为范例化的全景普吕克射线图,这提供了一个调和的像素级示意,大致兑现精准的录像头限定。这个方法的奥妙之处在于它将复杂的三维录像头通顺转念成了二维图像体式,就像把立体的跳摆动作纪录在平面的曲谱上。

普吕克射线图的构建过程基于录像头的内参矩阵K和外参矩阵E。关于图像中的每个像素点(u,v),它的普吕克镶嵌界说为六维向量,包含了完整的几何信息。这种示意方法的上风在于它大致完整保留三维空间中射线的悉数几何属性,不管录像头怎样挪动旋转,都大致准确纪录。

为了处罚不同录像头建立之间的兼容性问题,照料团队瞎想了范例和姿态不变的范例化方法。这个过程分为两步:当先是范例范例化,使用参考录像头的分享内参矩阵确保范例一致性,同期保抓各个录像头的独到视角。然后是姿态范例化,将录像头中心和标的向量都转念到参考录像头的坐标系中。

这种范例化的最大上风是构建了不同录像头视角下的调和三维普吕克空间中的轨迹,显耀丰富了轨迹散布的各样性。原始数据集的轨迹散布相对蚁集,而通过范例化处理后,系统大致生成愈加各样化的查考样本,就像把原来只消几种口味的冰淇淋膨大成了几十种不同的组合。

在本色应用中,输入轨迹当先通过无参数的范例化普吕克编码器转念为射线图,然后注入PDiT模块。范例化的全景射线图在空间和时候维度上进行下采样以对王人扩散潜变量,并被分块化为普吕克镶嵌令牌。这些令牌与扩散潜变量令牌聚集后输入到PDiT模块的三维全留心力层中。这种瞎想既轻量级又有用,为全景视频生成提供了精准且可泛化的限定。

四、弥远顾虑的智能计谋:活泼强制生成工夫

OmniNWM濒临的一个要道挑战是如安在弥远预测中保抓踏实性和准确性。这就像要求一个预言家不仅要预测来日会发生什么,还要准确预测一个月后的情况。为了处罚这个问题,照料团队诱导了一种名为"活泼强制计谋"的工夫,通过多级噪声注入来提高生成的活泼性和鲁棒性。

传统的自追思生成方法容易出现误差积累问题,就像寄语游戏中失实会越传越严重。活泼强制计谋的中枢念念想是在查考过程中特意"恣虐"部分历史信息,查考模子在不圆善条款下也能广泛使命。这种方法在查考时独随即向每个帧和每个视角注入噪声,让模子学会在部分信息丢失或不准确的情况下仍能作念出正确预测。

具体的噪声注入公式为:x(i,j) = x(i,j) + α(i) · εframe + β(j) · εview,其中εframe和εview是零丁的噪声向量,α(i)和β(j)是缩放因子。这种针对每个视角/帧的噪声有谈论比拟之前的调和噪声应用方法,能更好地处理时空诬蔑。

这种计谋最令东谈主振作的地方是它支抓两种不同的自追思推理模式。第一种是帧级自追思,雷同于一步一步仔细推理,从多个历史帧生成单个将来帧。这种模式特殊妥贴需要高精度的帧级轨迹霸术仿真。第二种是片断级自追思,更像是果敢的逾越式预测,从较少的输入生成多个将来帧。这种方法关于长视距生成愈加高效,同期保抓时候连贯性。

在推理过程中,历史帧不错被部分加噪以支抓两种生成模式。比如在片断级自追思中,单个历史帧不错四肢条款生成多个将来帧,而在后续阶段不错运用多个历史帧更好地运用动态先验。这种活泼性使得系统大致根据不同的应用需求弃取最合适的生成计谋。

实验收尾败露,这种活泼强制计谋在弥远生成中进展出色,大致产生突出大地真值序列长度的高质地收尾。在321帧对比241帧的测试中,带有活泼强制的模子在不同视频长度下都保抓了踏实的性能,而莫得使用这种计谋的模子在长序列上出现了显耀的质地下落。

五、智能安全评判:基于占用的密集奖励系统

OmniNWM的第三个紧迫改进是诱导了一套基于三维占用的智能安全评判系统。这就像给AI配备了一个教训丰富的驾驶教训,大致及时评判每个驾驶动作的安全性和合感性。传统的奖励系统时时依赖外部模子或通俗的法子,而OmniNWM径直运用生成的三维语义占用来界说基于法子的密集奖励。

这个奖励系统瞎想得相称东谈主性化和实用。它主要琢磨三个方面的驾驶进展:安全性、效任性和合规性。当先是碰撞奖励,当自车与按捺物发生碰撞时会受到处分,处分进程还与车速关联,体现了速率越快风险越大的实践逻辑。谈论公式为Rcol = -αcol · Icol · |v|,其中Icol是碰撞迷惑函数,当发生碰撞时为1,不然为0。

规模奖励温雅的是车辆是否保抓在可行驶区域内,这通过检测车辆是否离开"可行驶名义"类别来兑现。如若车辆驶入非可行驶区域,系统会给出相应的处分:Rbd = -αbd · Inon-drivable。这种瞎想确保了AI学会恪守基本的交通法子。

速率奖励饱读动车辆保抓安妥的宗旨速率,以促进交通服从。公式Rvel = -αvel · tanh(|v - vtarget|) · Iv奥妙地使用了双曲正切函数来平滑处分,幸免了突变带来的查考不踏实。当速率在合理范围内时,Iv为0,不赐与处分;超出范围时Iv为1,入手处分。

最终的总奖励函数整合了这三个方面:Rb = 1 + (Rcol + Rbd + Rvel)/Nreward。通过将三维占用转念为密集的航线点级反馈,这个奖励函数大致在各式场景下对计谋行径进行细粒度评估。

照料团队通过一个要道的当面卡车场景考证了奖励函数的有用性。在这个场景中,高速碰撞取得最低奖励并承受严重的碰撞处分;逃避不及会裁汰奖励;而获胜逃避则取得最高奖励,只消最小的限定处分和速率处分。这种折柳性评判能力阐明了系统大致正确识别和评价不同驾驶计谋的优劣。

六、视觉讲话行径智能体:多模态推理的圆善勾搭

为了充分剖释OmniNWM多模态输出的上风,照料团队还诱导了一个基于Qwen-2.5-VL的语义几何推理视觉讲话行径模子,称为OmniNWM-VLA。这个系统就像给AI配备了一个大致同期会通视觉、讲话和行径的超等大脑,大致进行复杂的多模态推理和轨迹霸术。

OmniNWM-VLA的中枢是一个名为三模态Mamba基础解释器(Tri-MIDI)的改进模块,这是一个轻量级的即插即用组件,大致将视觉、几何和语义信息会通成调和的潜在示意。这种瞎想让模子大致同期对外不雅(RGB)、三维结构(深度)和场景语义(分割)进行合资推理,这关于预测几何一致且语义合理的轨迹至关紧迫。

处理进程当先将对王人的多视角输入——RGB图像、度量深度图和语义分割图——拼接成调和的全景网格,以保抓跨视角的空间一致性。每种模态分别使用预查考编码器处理:CLIP用于RGB,SigLIP用于深度,SegFormer用于语义。然后通过特定于模态的多层感知机将特征投影到共同的镶嵌空间。

接下来,基于Mamba的状况空间模子在文本查询的率领下奉行跨模态会通,产生会通的潜在示意。系统使用令牌化事理(TOR)机制,在查询序列中插入特殊令牌来锚定中间推理要领。这些位置的输出令牌被投影到卑藐视觉讲话模子的潜在空间中,为模子提供空间和语义基础的踪迹。

与以2HZ产生要道帧的传统方法不同,OmniNWM-VLA在NuScenes数据集上以12HZ的频率运行,提供更良好的轨迹霸术。系统膨大了OmniNWM-VLA的输出通谈,不仅预测航线点的x和y坐标,还预测航向角。这种双输出体式关于构建范例化普吕克射线图至关紧迫,提供对全景视频生成的像素级限定。

在开动视频片断中,轨迹当先通过使用静态轨迹生成多模态收尾(RGB、深度和语义),然后输入OmniNWM-VLA进行多模态推理霸术。这种瞎想确保了高等决策制定与初级动作奉行之间的无缝聚集,在调和的自主驾驶活水线中有用聚集了高等推理和精准限定。

七、实验考证:全地方的性能测试与突破性收尾

照料团队在NuScenes和NuScenes-Occupancy数据集上进行了全面的实验考证,收尾败露OmniNWM在多个要道方针上都达到了起始进的性能水平。悉数这个词系统包含112.2亿参数,其中110亿参数来自与先前使命一致的扩散变换器主干集聚,新增的2.2亿参数用于跨视角留心力层。

在RGB视频生成质地方面,OmniNWM取得了突破性后果。使用Fréchet Inception Distance(FID)和Fréchet Video Distance(FVD)四肢评估方针,系统达到了5.45的FID分数和23.63的FVD分数,无需使用阻拦的体积化条款(如语义占用或团聚点云),就超越了悉数先前的方法。这个收尾阐明了合资多模态生成方法的有用性。

在深度图生成方面,照料团队使用完全相对误差和准确性阈值四肢范例方针,以LiDAR投影的大地真值进行评估。OmniNWM在完全相对误差和δ方针上都取得了优异的性能,不仅显耀超越了Dist-4D等生成方法,以致突出了泛化能力有限的判别方法。

占用预测质地的评估一样令东谈主印象深远。使用IoU和mIoU方针进行测试,OmniNWM仅使用RGB图像四肢输入就达到了33.3的IoU和19.8的mIoU,超越了悉数对比喻法,包括那些受益于精准三维几何测量的基于LiDAR的方法。这些收尾有劲阐明了合资生成范式的有用性。

录像头限定精度的测试使用旋转误差和平移误差方针,收尾败露范例化全景射线图编码显耀普及了限定性能。使用范例化方法的OmniNWM在旋转误差上达到了1.42×10^-2,平移误差为5.14×10^-2,昭彰优于未使用范例化的版块。旋转误差接近大地真值性能,而较高的平移误差反应了不同场景中驾驶距离的当然变化。

零样本泛化能力测试展现了系统的普遍适当性。在莫得微调的情况下,OmniNWM大致跨不同数据集(如nuplan或里面汇集的数据集)和录像头视角建立(如3个或6个录像头视角)进行有用使命。这种泛化能力主要归功于范例化普吕克射线图编码计谋,它创建了调和的限定示意。

轨迹霸术评估在150个NuScenes考证场景上进行,收尾败露不同VLA霸术基线之间存在昭彰互异。Impromptu-VLA比拟Qwen-2.5-VL取得了更高的性能,与OmniNWM-VLA的收尾特地。基于占用的奖励函数有用地折柳了这些VLA霸术器生成的霸术轨迹,阐明了评估系统的有用性。

消融照料进一步考证了各个组件的紧迫性。占用预测模块的消融败露,合资生成的语义和深度图分别带来3.0和2.7的mIoU改善,考证了语义和深度在凹凸文和几何建模方面的互补上风。活泼强制计谋的消融照料标明,该计谋在不同视频长度上都显耀改善了生成质地,特殊是在弥远生成序列中效果愈加昭彰。

八、工夫改进的深层价值与将来影响

OmniNWM的工夫改进不单是体现时性能方针的普及上,更紧迫的是它草创了一种全新的自动驾驶系统瞎想范式。这种范式的中枢价值在于将状况、动作和奖励三个要道要素调和在一个框架内,兑现了信得过兴趣上的端到端自动驾驶系统。

从工夫架构角度看,OmniNWM最大的突破在于冲突了传统系统中各个模块互相零丁的局限性。以往的自动驾驶系统就像一个单干明确但调换不畅的工场,感知模块、决策模块和限定模块各行其是,难以兑现最优的合座性能。而OmniNWM更像一个高度协调的交响乐团,各个"演奏者"不仅本事高妙,更紧迫的是大致圆善配合,演奏出和谐的乐章。

范例化全景射线图工夫的引入处罚了一个弥远困扰学术界和工业界的费劲:如安在不同的硬件建立和数据体式之间兑现无缝切换。这种工夫就像创造了一种"天下语",让不同"方言"的系统大致互相会通和互助。这关于自动驾驶工夫的范例化和产业化具有紧迫兴趣。

基于占用的密集奖励系统代表了另一个紧迫的工夫进步。传统的奖励系统时时依赖通俗的法子或外部评估,难以捕捉复杂驾驶场景中的幽微判袂。OmniNWM的奖励系统就像一个教训丰富的驾驶教训,大致从三维空间的角度全面评估驾驶行径,提供愈加精准和有兴趣的反馈。

活泼强制计谋的改进兴趣在于它为弥远预测问题提供了一个通用的处罚有谈论。这种方法不仅适用于自动驾驶,还不错推论到其他需要弥远序列预测的领域,如天气预告、股票阛阓分析等。它的中枢念念想是通过"特意犯错"来增强系统的鲁棒性,这种反直观的方法体现了深度学习领域的一个紧迫趋势。

从本色应用的角度来看,OmniNWM的工夫改进为自动驾驶的贸易化部署扫清了紧迫按捺。弥远以来,自动驾驶系统在复杂场景下的可靠性一直是制约贸易化的要道要素。OmniNWM通过提供愈加全面、准确和踏实的环境会通能力,显耀普及了系统在各式复杂情况下的进展。

系统的零样本泛化能力特殊值得温雅,这意味着一朝查考完成,系统不错径直应用到不同的车辆平台和传感器建立上,无需再行查考或大幅修改。这种能力大大裁汰了工夫部署的资本和复杂性,为自动驾驶工夫的鸿沟化应用创造了故意条款。

在安全性方面,OmniNWM的密集奖励系统提供了一种量化评估驾驶安全性的新方法。这种评估不仅琢磨了碰撞风险,还轮廓琢磨了交通服从和法子恪守等多个维度,为建立自动驾驶安全范例提供了工夫基础。

商量将来,OmniNWM的工夫架构为更高等别的自动驾驶功能提供了基础平台。比如,系统不错进一步膨大到支抓复杂的交通场景会通、多车协同驾驶、动态旅途霸术等高等功能。更紧迫的是,这种调和的框架为集成其他AI工夫(如大讲话模子、多模态学习等)提供了接口和范例。

说到底,OmniNWM代表的不单是是一个工夫居品,更是一种新的念念维阵势和系统瞎想形而上学。它告诉咱们,信得过的智能系统不应该是各式功能的通俗堆叠,而应该是一个有机调和的合座,各个组件之间互相协调、互相增强。这种合座性念念维关于诱导下一代东谈主工智能系统具有紧迫的率领兴趣。

从更宏不雅的角度看,OmniNWM的获胜也反应了中国在东谈主工智能领域,特殊是自动驾驶工夫方面的快速进步。上海交通大学等国内照料机构在这一前沿领域取得的突破,不仅普及了中国在海外学术界的影响力,也为国内自动驾驶产业的发展提供了强有劲的工夫支抓。这种工夫改进能力的普及,关于中国在将来智能交通和灵巧城市建筑中占据上风地位具有紧迫兴趣。

Q&A

Q1:OmniNWM比拟传统自动驾驶系统有什么突破?

A:OmniNWM最大的突破是兑现了"三位一体"的瞎想,大致同期处理状况感知、精准限定和安全评判。它不错同期生成彩色图像、语义信息、深度数据和三维空间模子,还能精准限定捏造录像头并径直评判驾驶安全性,这所昔日的系统无法作念到的。

Q2:范例化全景射线图工夫有什么本色作用?

A:这项工夫就像创造了自动驾驶的"通用讲话",让系统大致在不同的录像头建立和数据集之间无缝切换,无需再行查考。它将复杂的三维录像头限定转念成二维图像体式,兑现了极其精准的视角限定,大大提高了系统的适当性和通用性。

Q3:OmniNWM能生成多永劫候的一语气预测?

A:OmniNWM不错生成长达321帧的一语气视频序列,远超传统方法的预测长度。通过活泼强制计谋,系统在弥远预测中保抓了很好的踏实性和准确性,这关于自动驾驶的本色应用相称紧迫,因为车辆需要提前较永劫候霸术旅途。

Powered by 开云提款靠谱欢迎您✅ 官方入口 @2013-2022 RSS地图 HTML地图

Copyright Powered by站群 © 2013-2024